Utilisation de solutions d'imagerie infrarouge et en temps de vol pour améliorer les fonctionnalités robotiques

Avec la contribution de Rédacteurs nord-américains de DigiKey

2016-05-19

L'imagerie est essentielle pour de nombreuses applications robotiques, afin d'effectuer des tâches de base, d'éviter des obstacles, de naviguer et d'assurer la sécurité de base. La façon la plus évidente de fournir une image est d'utiliser une caméra vidéo à faible coût, ou mieux encore, deux caméras de ce type pour obtenir une vision stéréo et une perception de la profondeur. Toutefois, cette dernière option présente quelques inconvénients.

L'utilisation de deux caméras pour une imagerie 3D augmente non seulement la consommation énergétique et les exigences en termes d'espace, mais présente également un format et un processus de fabrication plus complexes, ce qui engendre des coûts plus élevés. Étant donné que l'imagerie 3D est une pratique qui se généralise dans les applications allant des unités « d'assistance » aux véhicules autonomes, les concepteurs ont besoin d'une meilleure alternative que l'ajout de caméras supplémentaires.

C'est pourquoi les concepteurs utilisent progressivement d'autres alternatives, qui présentent des avantages en termes de format, de coût, de consommation énergétique, de réduction des données et de performances globales. Parmi ces alternatives, citons les systèmes d'imagerie en temps de vol (TOF), qui sont souvent appelés LIDAR (détection et télémétrie par la lumière). Ceux-ci peuvent être complétés par une imagerie infrarouge (IR), qui est souvent appelée thermographie.

Solution infrarouge (IR)

Les ondes électromagnétiques infrarouges présentent des longueurs d'onde plus importantes que celles qui se trouvent à l'extrémité rouge du spectre visible ; la plage des longueurs d'onde de la bande IR varie généralement de 700 nm (0,7 μm) à 1 mm (1000 μm). En termes plus simples, elles représentent la chaleur émanant d'un objet. Avec un système d'imagerie IR approprié, cette « carte thermique » IR se transforme en une image à rayonnement visible, souvent avec l'ajout de fausses couleurs pour mettre en évidence les températures relatives (Figure 1).

Figure 1 : Image infrarouge d'eau s'écoulant d'un robinet vers une baignoire ; notez l'utilisation de « fausses couleurs » pour mieux distinguer les différences de température. (Image fournie avec l'autorisation de FLIR Systems, Inc.)

Notez que l'imagerie IR est différente de la détection IR. La détection est une méthode sans contact utilisée pour détecter, voire mesurer, une source de chaleur, telle qu'une personne qui passe devant un capteur infrarouge passif (PIR) dans un système d'alarme, ou une chaleur excessive provenant d'un tuyau sous surveillance ; il n'existe aucun détail d'image ni aucune résolution d'image.

Pourquoi utiliser l'IR au lieu, ou en complément, de l'imagerie à rayonnement visible traditionnelle ? Plusieurs raisons expliquent ce choix :

- L'IR est efficace lorsque les objets d'intérêt se fondent avec l'arrière-plan, de façon délibérée ou par simple coïncidence.

- L'IR permet de localiser des personnes ou des animaux à sang chaud dans le champ de vision.

- L'IR est également utile lors de la recherche de défaillances courantes, comme un tuyau en surchauffe, une conduite de vapeur, un feu couvant ou un dysfonctionnement électrique, qui peuvent provoquer un échauffement localisé.

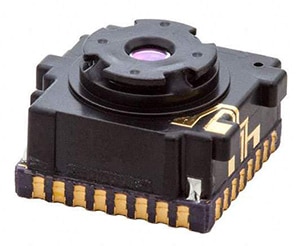

La mise en œuvre d'un système d'imagerie IR est désormais simplifiée grâce à des composants hautement intégrés et à hautes performances, qui présentent des interfaces faciles à utiliser. Citons, par exemple, la caméra IR Lepton de FLIR Systems, Inc. (Figure 2). Mesurant approximativement 10 mm × 12 mm × 6 mm de profondeur, ce modèle intègre un objectif à focale fixe, un ensemble de capteurs microbolométriques d'infrarouges à ondes longues (LWIR) de 80 × 60 pixels pour les IR de 8 à 14 μm et les composants électroniques de traitement des signaux.

Figure 2 : L'imageur FLIR Lepton (modèle illustré sans prise) est une unité hautement intégrée qui comprend des fonctionnalités programmables par l'utilisateur et de traitement des signaux. (Image fournie avec l'autorisation de FLIR Systems, Inc.)

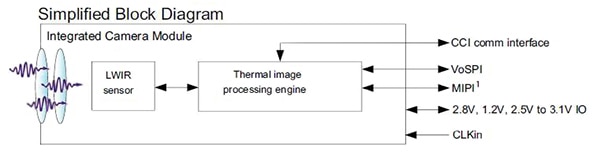

L'interconnexion est simplifiée grâce à l'utilisation d'interfaces vidéo MIPI et SPI standard et de l'interface de commande série de type I2C à deux fils (Figure 3). Malgré sa petite taille et sa simplicité d'utilisation, le modèle Lepton fournit de hautes performances avec un accès rapide à l'image en moins de 0,5 s et une sensibilité thermique inférieure à 50 mK. La puissance de fonctionnement est également faible : 150 mW (typique).

Figure 3 : Ce schéma fonctionnel simplifié du modèle Lepton montre son unité de traitement d'image dans son intégralité, en plus de l'ensemble de capteurs de base, ainsi que son interface simple vers le système de l'utilisateur. (Image fournie avec l'autorisation de FLIR Systems, Inc.)

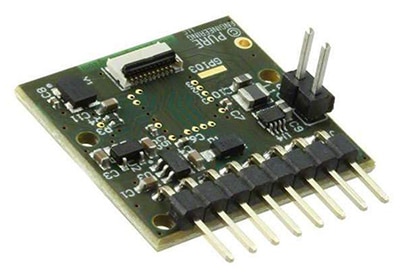

Les produits de ce type tirent parti de l'expérience pratique des utilisateurs, ce qui permet à FLIR de proposer une carte Breakout pour le module de caméra qui est compatible avec les cartes d'évaluation basées sur ARM et Raspberry Pi (Figure 4). Cette carte de 25 mm × 24 mm nécessite une alimentation simple de 3 V à 5,5 V et comprend une horloge système de 25 MHz, des LDO internes pour des rails d'alimentation à faible bruit supplémentaires et des embases d'interconnexion standard, ainsi qu'une embase Molex à 32 broches pour le module Lepton lui-même.

(a)

(b)

Figure 4 : La carte Breakout du modèle Lepton (a) (illustrée sans l'unité Lepton) permet aux concepteurs d'évaluer et de programmer l'unité à l'aide de diverses cartes d'évaluation, grâce à son connecteur et à son interface standard (b). (Images fournies avec l'autorisation de FLIR Systems, Inc.)

Lancement du TOF

Pour de nombreuses applications, une image thermique est utile, mais insuffisante. Un système d'imagerie à rayonnement visible est ainsi nécessaire, souvent en 3D. La solution évidente est d'utiliser une caméra vidéo standard. Différents modèles de caméra sont en effet désormais disponibles auprès de nombreux fournisseurs, avec un vaste choix d'options de résolution, de sensibilité à la lumière, de taille et d'interface. Si vous avez besoin d'une imagerie stéréo, utilisez deux caméras.

Contrairement à la thermographie, qui occupe le secteur depuis des décennies, mais avec des performances plus grossières, des coûts supérieurs et une dissipation de puissance plus importante par rapport aux unités actuelles, la solution TOF est relativement nouvelle. Cette solution a d'abord été proposée en tant que concept théorique dans les années 1990. Toutefois, les composants nécessaires et les capacités de traitement pour la mettre en pratique n'ont été rendus disponibles qu'au cours de la dernière décennie.

La solution TOF est souvent l'approche d'imagerie préférée pour de nombreuses applications, notamment pour les véhicules autonomes (voitures sans conducteur) et a été littéralement testée sur route sur des millions de kilomètres. (En termes d'architecture, un véhicule intelligent ou autonome est un type spécialisé de système robotique sur roues, avec des capteurs, des algorithmes et des actions définies ; il s'agit simplement d'une question de point de vue.) L'approche TOF présente de réels avantages par rapport à une caméra d'imagerie traditionnelle (voir ci-dessous).

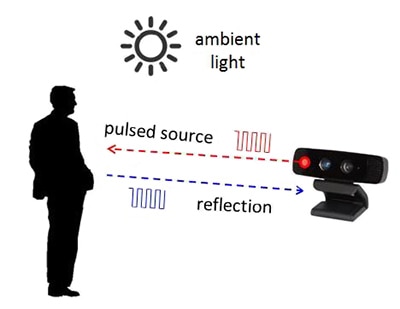

Principe de fonctionnement : contrairement à l'imagerie utilisant une caméra traditionnelle, dans laquelle les principes de fonctionnement sont généralement compris par les ingénieurs et sont plus ou moins intuitifs, l'approche TOF est beaucoup moins connue et repose sur des équations autant que sur les photons détectés pour la mise en œuvre. Voici ses deux composants essentiels : une source lumineuse contrôlée et modulée avec précision, qui est un laser statique ou une DEL (fonctionnant généralement dans la plage proche infrarouge de 850 μm et, de ce fait, invisible à l'œil humain) et une matrice de pixels pour « voir » les réflexions de la lumière émise à partir de la scène imagée (Figure 5).

Figure 5 : Il suffit de projeter une lumière pulsée sur la scène et de capturer les impulsions de lumière réfléchie et leur temporisation ; la mise en œuvre est beaucoup plus compliquée, mais est désormais pratique. (Image fournie avec l'autorisation de Texas Instruments)

Pour comprendre pleinement le principe du TOF, celui-ci nécessite des équations qui définissent son fonctionnement et sont également utilisées pour expliquer certaines sources d'erreurs inévitables, puis fournissent des compensations pour ces erreurs. Le processus TOF général peut être effectué de deux façons : la source lumineuse est pulsée de façon répétée à un faible rapport cyclique ou est modulée par une source d'ondes carrées ou d'ondes sinusoïdales continues. En mode pulsé, l'énergie de la lumière réfléchie est échantillonnée à l'aide de deux fenêtres hors phase et ces échantillons sont utilisés pour calculer la distance séparant de la cible. En mode continu, le capteur prend quatre échantillons par mesure, chaque échantillon étant décalé de 90⁰, et l'angle de phase entre l'éclairage et la réflexion (soit la distance) peut être calculé.

La sortie d'une séquence TOF et les calculs sont un nuage de points représentant les zones imagées, d'où le nom de « nuage de points ».[1]

Avantages et inconvénients liés : choisir entre une solution d'imagerie traditionnelle utilisant une caméra ou deux caméras et une approche TOF implique un compromis axé sur les détails de l'application. Pour les tâches de base d'inspection et de reconnaissance des défaillances, où l'objet est connu à l'avance et l'objectif est l'extraction/la comparaison de fonctionnalités dans un environnement à éclairage contrôlé, une seule caméra fournissant une image 2D est souvent la meilleure option. Cependant, en cas de variation d'éclairage, l'approche TOF peut être plus efficace, car celle-ci est moins sensible aux variations de la lumière ambiante.

Pour une imagerie 3D utilisant deux caméras traditionnelles, la décision implique davantage d'aspects, à commencer par les problèmes d'ordre mécanique et ceux liés au montage. Même si cela ne constitue pas une préoccupation, le système qui traite l'image doit disposer d'algorithmes robustes pour résoudre les problèmes de « correspondance » entre un point de la scène provenant d'une caméra et le même point de la scène provenant de la deuxième caméra. Cette procédure nécessite une quantité considérable de variation d'échelle de gris ou de couleur. En outre, la précision de la profondeur est souvent limitée en raison d'une surface uniforme de la scène imagée. En revanche, un système TOF est moins sensible aux problèmes mécaniques, ainsi qu'aux problèmes d'éclairage et de contraste, et ne nécessite pas de mise en correspondance des images pour obtenir un résultat 3D.

En raison de leur temps de réponse rapide et de leur capacité à gérer des plages étendues de caractéristiques d'un sujet, ainsi que de la nature du nuage de points qu'ils génèrent, les systèmes TOF sont particulièrement adaptés à la traduction de gestes des mains, du visage ou du corps en commandes, ainsi qu'à la capture des éléments de l'environnement dans les véhicules autonomes. Cependant, les solutions utilisant des configurations à une ou deux caméras traditionnelles présentent des coûts inférieurs, en raison de la grande disponibilité des caméras d'imagerie de base.

Mise en œuvre : un système TOF comprend cinq blocs fonctionnels principaux :

- Source lumineuse : un composant conçu pour générer les impulsions lumineuses soigneusement temporisées

- Éléments optiques : un objectif pour focaliser la lumière sur le capteur ; celui-ci est probablement également équipé d'un filtre passe-bande optique pour réduire le « bruit » de la lumière ambiante

- Capteur d'image : celui-ci permet de capturer les réflexions de la lumière émise à partir de la scène éclairée

- Composants électroniques de gestion : permettent de contrôler et de synchroniser l'unité d'éclairage et le capteur d'image

- Interface et unité de calcul : permettent de calculer la distance en fonction de la temporisation de l'éclairage par rapport aux photons renvoyés et détectés

La sélection de l'émetteur de lumière et du capteur d'imagerie constitue la première étape de la configuration d'un système TOF. Il est possible de choisir un émetteur de type diode, tel que le modèle VSMY1850X01 de Vishay, un dispositif IR 850 μm conçu pour un fonctionnement haute vitesse. Celui-ci prend en charge des temps de montée et de descente de 10 ns lorsqu'il est commandé par une intensité de 100 mA, et il est ainsi bien adapté au mode d'impulsion.

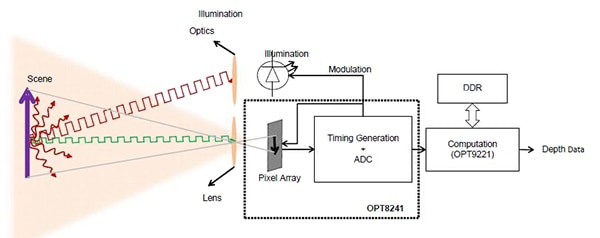

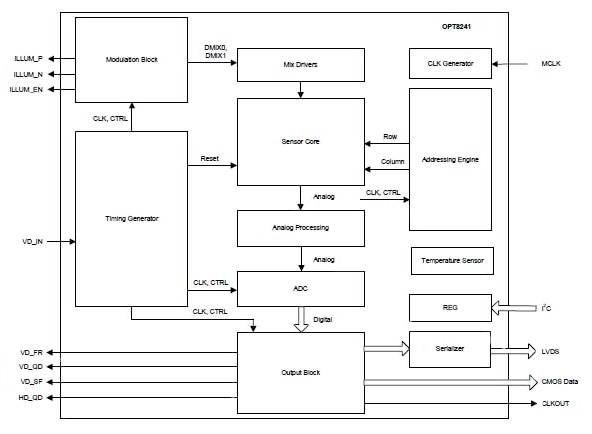

La matrice de pixels ou de capteurs est le cœur du système TOF. Celle-ci est désormais disponible dans le cadre d'un dispositif de plus grande taille avec un niveau d'intégration plus élevé, tel que le capteur de temps de vol/circuit intégré de contrôleur OPT8241 de Texas Instruments (Figure 6). Elle comprend la source du capteur (élément 3 ci-dessus) et des composants électroniques de contrôle (élément 4), comme indiqué dans le schéma fonctionnel correspondant (Figure 7), et elle fournit des données de réflexion numérisées vers un coprocesseur, comme le contrôleur de temps de vol OPT9221, qui calcule les données de profondeur provenant des données de capteur numérisées. Le modèle OPT9221 met également en œuvre diverses fonctions de correction, y compris l'antirepliement, la compensation de non-linéarité et la compensation de température.

Figure 6 : En utilisant conjointement la solution OPT8241 de TI avec le moteur de calcul OPT9221, les concepteurs peuvent créer un système TOF avec peu de matériel et avec relativement peu de composants.

Figure 7 : Le schéma fonctionnel interne simplifié du modèle OPT8241 de TI montre un aspect de la complexité qu'il utilise pour mettre en œuvre les circuits d'entrées TOF ; celui-ci inclut un contrôle de modulation et un circuit d'attaque pour la DEL lumineuse. (Image fournie avec l'autorisation de Texas Instruments)

Comme avec n'importe quel système vidéo conçu non seulement pour capturer une scène, mais devant également effectuer cette opération de manière cohérente et utile, la conception du logiciel TOF n'est pas facile. TI propose un guide d'utilisation détaillé[2], ainsi qu'un outil d'estimation qui permet aux concepteurs d'évaluer les performances et l'interaction des paramètres, tels que la résolution de la profondeur, la résolution 2D (nombre de pixels), la plage de distance, la fréquence d'image, le champ de vision (FoV), la lumière ambiante et la réfraction de l'objet.

Conclusion

Les concepteurs de systèmes robotiques ont toujours été confrontés au défi de pouvoir fournir une solution détaillée de « détection d'environnement ». Heureusement, les concepteurs ont actuellement accès à des technologies hautes performances, puissantes et relativement économiques, notamment l'imagerie infrarouge, les caméras vidéo traditionnelles et même des solutions LIDAR basées sur les principes de temps de vol. De ce fait, et en raison de leur faible consommation énergétique globale, de nombreuses conceptions complètes utilisent une combinaison de ces approches pour pallier les inconvénients de toute technique prise individuellement et fournir ainsi une image plus complète et multidimensionnelle.

Références :

- Time-of-Flight Camera - An Introduction (Caméra temps de vol : présentation), Texas Instruments

- Introduction to the Time-of-Flight (ToF) System Design (Présentation du système de temps de vol, TOF), Texas Instruments

Avertissement : les opinions, convictions et points de vue exprimés par les divers auteurs et/ou participants au forum sur ce site Web ne reflètent pas nécessairement ceux de DigiKey ni les politiques officielles de la société.