La pioggia smorza l'entusiasmo per i veicoli autonomi

Elon Musk ha dichiarato che Tesla intende implementare la guida autonoma utilizzando solo le telecamere per vedere cosa c'è attorno al veicolo in ogni momento. L'approccio di Tesla contrasta con quello del resto del settore automotive. La maggior parte dei sistemi di guida autonoma si basa su un mix di telecamere, radar e lidar per capire cosa c'è sul percorso di un veicolo. Il motivo di questo approccio multi-sensore è la convinzione che solo le tecnologie a sensori multipli possano risolvere scenari che risultano confusi per le tecnologie di rilevamento specifiche.

Data la posizione di Tesla sul rilevamento delle telecamere, è interessante rivedere alcuni dei problemi che affliggono i sensori dei veicoli autonomi nonostante anni di test e ricerche. In primo luogo, prendiamo in considerazione le telecamere. L'esempio classico di uno scenario problematico per le telecamere sui veicoli è quando affrontano in salita una collina di fronte al sole che tramonta. La luce del sole acceca momentaneamente la telecamera, proprio come accade a una persona. Quando il veicolo scende dalla collina verso una valle buia, la telecamera può essere momentaneamente accecata perché impiega un po' di tempo ad adattarsi alla relativa oscurità.

Ci sono anche "casi limite" che possono confondere le telecamere ma non altri tipi di sensori. Nel mondo dell'intelligenza artificiale, i casi limite sono situazioni strane che si verificano nella vita reale e che gli algoritmi di apprendimento automatico non hanno mai incontrato. L'esempio classico di un caso limite che potrebbe confondere i sensori costituiti da telecamere è quello di un paesaggio dipinto sul retro di un camion. La telecamera montata sull'auto dietro il camion potrebbe non rendersi conto che il paesaggio è solo un'immagine.

È possibile aggirare queste difficoltà solo utilizzando la tecnologia delle telecamere: l'aggiunta di una telecamera a infrarossi potrebbe essere d'aiuto. Ma c'è un altro ostacolo che affligge le telecamere e altri sensori di guida autonoma: il maltempo.

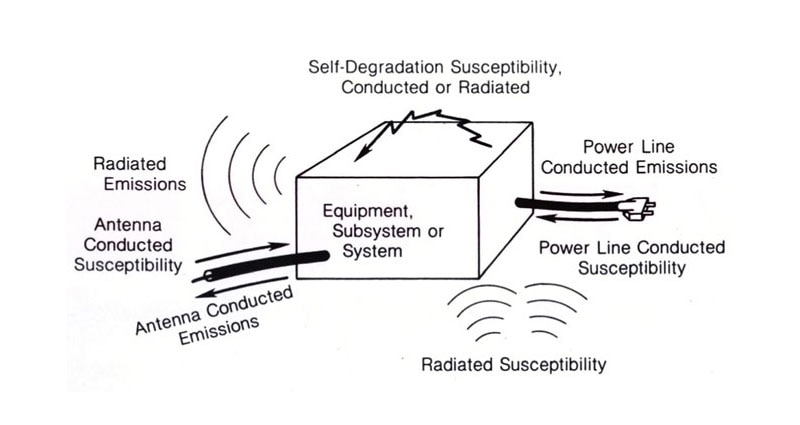

(Immagine per gentile concessione di Littelfuse)

(Immagine per gentile concessione di Littelfuse)

Una singola goccia d'acqua (o un fiocco di neve) caduta proprio sull'obiettivo può mettere fuori uso una telecamera. Le gocce di pioggia che non colpiscono l'obiettivo possono comunque produrre variazioni di intensità nelle immagini e nei fotogrammi che complicano il processo di identificazione degli ostacoli. In particolare, ogni goccia di pioggia blocca parte della luce altrimenti riflessa dagli oggetti sulla visuale. Inoltre, le strisce di pioggia riducono il contrasto generale della scena. Nei test condotti alla Michigan State University qualche anno fa, i ricercatori hanno scoperto che gli algoritmi basati sulle telecamere non riuscivano a rilevare fino al 20% degli oggetti in presenza di pioggia leggera. In caso di pioggia più intensa, il tasso di errore degli algoritmi di visione saliva fino al 40%.

Esistono algoritmi "che eliminano la pioggia" studiati per aiutare i sistemi basati su telecamere a rilevare gli oggetti. Ma fino ad oggi il loro funzionamento non è affidabile. Uno dei motivi è che questi algoritmi sono stati testati principalmente su scenari sintetici di pioggia, molto meno complessi di quelli reali.

I radar e i lidar hanno anch'essi i loro problemi quando si tratta di viaggiare sotto la pioggia o la neve. È facile capire perché. Entrambi i meccanismi di rilevamento si basano sui riflessi degli oggetti per localizzare e identificare ciò che si trova davanti. Quando i riflessi tornano indietro dalle gocce di pioggia o dai fiocchi di neve, è difficile capire cosa c'è oltre la neve e la pioggia.

È stato appurato che la pioggia leggera non disturba molto il lidar. Ma la pioggia battente può formare masse che un sensore lidar può interpretare come ostacoli. Inoltre, i test hanno dimostrato che il pulviscolo d'acqua sollevato da altri veicoli dopo un temporale può creare falsi bersagli lidar. (I lettori che vogliono approfondire questo problema potrebbero provare a seguire per un po' un TIR durante un temporale su un'autostrada.) Idem per la neve. I dati di prova sul comportamento del lidar in presenza di neve sono scarsi, ma sembra che la neve possa impedire al lidar di vedere gli oggetti o creare falsi ritorni. Ad esempio, un test condotto in Finlandia e Svezia ha rilevato che i vortici di neve, generati da un'auto che precede, possono falsare le letture del lidar.

Il radar si comporta meglio del lidar sotto la pioggia e la neve. La neve bagnata sembra causare i maggiori problemi. Il principale inconveniente del radar in caso di atmosfera bagnata sembra essere una minore capacità di rilevare oggetti con sezioni trasversali più piccole, come i pedoni.

Ovviamente il rilevamento dei veicoli autonomi in caso di maltempo è ancora un tema di ricerca. Un approccio in fase di studio utilizza due sensori invece di uno per rilevare gli oggetti. Se un sensore rileva un oggetto che l'altro non rileva, una matematica sofisticata cerca di determinare quale dei due abbia ragione. Crediamo che le case automobilistiche non siano entusiaste di questo schema specifico perché aumenta il numero di sensori sul veicolo, ma sono allo studio anche altri approcci.

Alla fine, le case automobilistiche saranno probabilmente in grado di vedere la strada in qualsiasi condizione meteo. Almeno per i veicoli, quindi, potrebbe avverarsi una variante di un vecchio detto: non esiste il maltempo, ma solo condizioni meteo diverse per la guida.

Have questions or comments? Continue the conversation on TechForum, DigiKey's online community and technical resource.

Visit TechForum